הזיות בינה מלאכותית מתייחסות למקרים שבהם מודלים של בינה מלאכותית, במיוחד מודלים של שפה גדולה (LLMs), מייצרים מידע שנראה נכון אך אינו נכון או לא קשור לקלט. תופעה זו מציבה אתגרים משמעותיים, שכן היא עלולה להוביל להפצת מידע שקרי או מטעה.

הזיות אלו אינן שגיאות אקראיות אלא נובעות לרוב מ:

- האינטראקציות המורכבות של הנתונים שאתה מאמן את המודלים עליהם,

- עיצוב הדגם,

- איך המודל מפרש הנחיות.

לפיכך, טיפול בהזיות בינה מלאכותית הופך להיות קריטי עבור האמינות והאמינות של מערכות בינה מלאכותית. זה חיוני ביישומים שבהם אתה צריך דיוק ונכונות עובדתית. בואו נבין זאת ביתר פירוט.

גורמים להזיות בינה מלאכותית

הזיות בינה מלאכותית יכולות לנבוע מגורמים שונים, כגון:

פירושים שגויים של AI עקב נתוני אימון לקויים

האיכות, הגיוון והייצוגיות של נתוני ההדרכה משפיעים על האופן שבו מודלים של AI מפרשים ומגיבים לתשומות. נתוני אימון לא מספקים או מוטים עלולים להוביל למודלים של בינה מלאכותית שיוצרים תפוקות שגויות או מטעות. בחירת נתוני האימון הנכונים היא חיונית כדי להבטיח שלמודל יש הבנה מאוזנת ומקיפה של הנושא.

שגיאות למידת מכונה עקב התאמת יתר

התאמה יתר מתרחשת כאשר מודל AI מאומן על מערך נתונים מוגבל. זה גורם למודל לשנן תשומות ותפוקות ספציפיות במקום ללמוד להכליל. חוסר הכללה זה יכול לגרום למודל לייצר הזיות כאשר הוא נתקל בנתונים חדשים.

שגיאות פירוש בינה מלאכותית עם ניבים או סלנג

מודלים של בינה מלאכותית עשויים להיאבק עם ניבים או ביטויי סלנג שהם לא נתקלו בנתוני האימון שלהם. חוסר היכרות זה יכול להוביל לחריגות פלט בינה מלאכותית.

עיוותים של נתוני AI מהתקפות יריבות

התקפות יריבות הכוללות הנחיות שנועדו בכוונה להטעות או לבלבל בינה מלאכותית יכולות לעורר הזיות. התקפות אלו מנצלות את פגיעויות העיצוב וההדרכה של המודל.

הנדסה מהירה גרועה

האופן שבו אתה בונה ומציג הנחיות למודל AI יכול להשפיע באופן משמעותי על התפוקות שלו. הנחיות מעורפלות או מעורפלות עלולות להוביל לכך שהדגם הוזה או ייצור מידע לא רלוונטי או שגוי. לעומת זאת, הנחיות בנויות היטב המספקות הקשר והכוונה ברורים יכולות להנחות את המודל ליצור תגובות מדויקות ורלוונטיות יותר.

טכניקות להפחתת הזיות AI

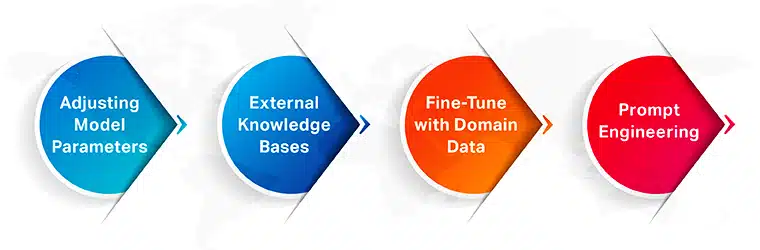

הפחתת הזיות במודלים של AI, במיוחד מודלים של שפות גדולות, כרוכה בשילוב של אסטרטגיות טכניות:

התאמת פרמטרים של דגם

הגדרת פרמטר הטמפרטורה ל-0 יכולה להניב תוצאות מדויקות יותר. הטמפרטורה שולטת באקראיות ביצירת התגובה של הדגם. טמפרטורה נמוכה יותר פירושה שהמודל יכול לבחור את המילים והביטויים הסבירים ביותר לקבלת פלטים צפויים ואמינים יותר. התאמה זו חשובה במיוחד עבור משימות הדורשות דיוק עובדתי ועקביות.

מאגרי ידע חיצוניים

שימוש במקורות נתונים חיצוניים לאימות יכול להפחית משמעותית את השגיאות היצירתיות. הוא יכול להתייחס לנתונים חיצוניים אלה בעת יצירת תגובות על ידי מתן מידע עדכני ומאומת למודל. גישה זו הופכת את הבעיה היצרנית גרידא למשימת חיפוש או סיכום פשוטה יותר המבוססת על הנתונים שסופקו.

כלים כמו Perplexity.ai ו-You.com מדגימים את היעילות של שיטה זו על ידי סינתזה של פלטי LLM עם נתונים מגוונים שאוחזר ממקורות חיצוניים.

כוונון עדין עם נתונים ספציפיים לתחום

אימון מודלים עם נתונים ספציפיים לתחום משפר את הדיוק שלהם ומפחית הזיות. תהליך זה חושף את המודל לתבניות ודוגמאות הרלוונטיות לתחום או לנושא ספציפי. בדרך זו, אתה יכול ליישר את הפלטים שלו עם תחום היעד.

כוונון עדין כזה מאפשר למודל ליצור תגובות מתאימות ומדויקות יותר מבחינה הקשרית. זה חיוני ביישומים מיוחדים כמו רפואה, משפטים או כספים.

הנדסה מהירה

עיצוב ההנחיות ממלא תפקיד מפתח בהפחתת הזיות. הנחיות ברורות ועתירות הקשר מנחות את מודל הבינה המלאכותית בצורה יעילה יותר. הם יכולים להפחית תפיסות מוטעות ואי בהירות של AI ולכוון את המודל ליצירת תגובות רלוונטיות ומדויקות.

המודל שלך פחות יפיק פלטים לא רלוונטיים או שגויים אם תציין את צורכי המידע בצורה ברורה ותספק את ההקשר הדרוש.

אסטרטגיות מתקדמות להפחתת הזיות

אתה יכול למנף שלוש שיטות מתקדמות להפחתת הזיות AI במודלים של שפות גדולות, הכוללות:

Generation-Augmented Generation (RAG)

שיטה זו משלבת את היכולות היצירתיות של LLMs עם מסד נתונים וקטורי הפועל כבסיס ידע. כאשר שאילתה מוזנת, המודל ממיר אותה לוקטור סמנטי ומחזיר מסמכים עם וקטורים דומים.

לאחר מכן, ה-LLM משתמש במסמכים אלה ובשאילתה המקורית כדי ליצור תגובה מדויקת יותר ורלוונטית יותר מבחינה הקשרית. RAG בעצם מצייד את ה-LLM בצורה של זיכרון לטווח ארוך. זה מאפשר ל-LLM לגשת ולשלב נתונים חיצוניים.

נימוק עם הנחיית שרשרת מחשבה

לימודי תואר שני מצטיינים במשימות כמו חיזוי מילים, סיכום מידע והפקת נתונים עקב התקדמות בשנאים. הם יכולים גם לעסוק בתכנון ובנימוקים מורכבים.

הנחיה של שרשרת מחשבה עוזרת ל-LLMs לפרק בעיות מרובות שלבים לשלבים ניתנים לניהול. זה משפר את יכולתם לפתור משימות חשיבה מורכבות. שיטה זו משופרת על ידי שילוב דוגמאות ממסד נתונים וקטור, המספק הקשר נוסף ודוגמאות ל-LLM להסתמך עליהן. התשובות המתקבלות מדויקות וכוללות את ההיגיון מאחוריהן, המאוחסנות עוד יותר במסד הנתונים הווקטוריים כדי לשפר תגובות עתידיות.

שאילתה איטרטיבית

תהליך זה כולל סוכן AI המאפשר אינטראקציות איטרטיביות בין ה-LLM לבין מסד נתונים וקטוריים. הסוכן מבצע שאילתה במסד הנתונים באמצעות שאלה, מחדד את החיפוש על סמך שאלות דומות שנשלפו, ולאחר מכן מסכם את התשובות.

אם אתה מוצא שהתשובה המסוכמת אינה מספקת, התהליך חוזר על עצמו. שיטה זו, המודגמת על ידי יצירת אחזור פעיל צופה פני עתיד (FLARE), משפרת את איכות התשובה הסופית על ידי חידוד הדרגתי של השאילתה והתגובה באמצעות איטרציות מרובות.

סיכום

התגברות על הזיות במודלים של AI דורשת גישה רב-גונית. הוא חייב לשלב התאמות טכניות עם אסטרטגיות חשיבה מתקדמות. שילוב שיטות הפחתה יכול לשפר משמעותית את הדיוק והאמינות של תגובות AI. אסטרטגיות אלו מטפלות בבעיות המיידיות של הזיות AI וסוללות את הדרך למערכות AI חזקות ואמינות יותר בעתיד.